Estudiante demuestra que el algoritmo de Twitter tiene un ‘sesgo’ hacia rostros más claros, delgados y jóvenes

La empresa le pagó 3,500 dólares a Bogdan Kulynych, quien demostró un problema en el software de recorte de imágenes.

El algoritmo de recorte de imágenes de Twitter prefiere los rostros más jóvenes, delgados y de piel más clara, según una investigación sobre el sesgo algorítmico de la empresa.

El hallazgo, aunque vergonzoso para la compañía, que ya había pedido disculpas a los usuarios tras recibir informes de sesgo, marca la conclusión satisfactoria de la primera “recompensa por errores algorítmicos” de Twitter.

La empresa pagó 3 mil 500 dólares a Bogdan Kulynych, estudiante de posgrado de la universidad EFPL de Suiza, quien demostró el sesgo en el algoritmo que se utiliza para centrar las vistas previas de las imágenes en las partes más interesantes de las mismas, como parte de una competencia en la conferencia de seguridad DEF CON de Las Vegas.

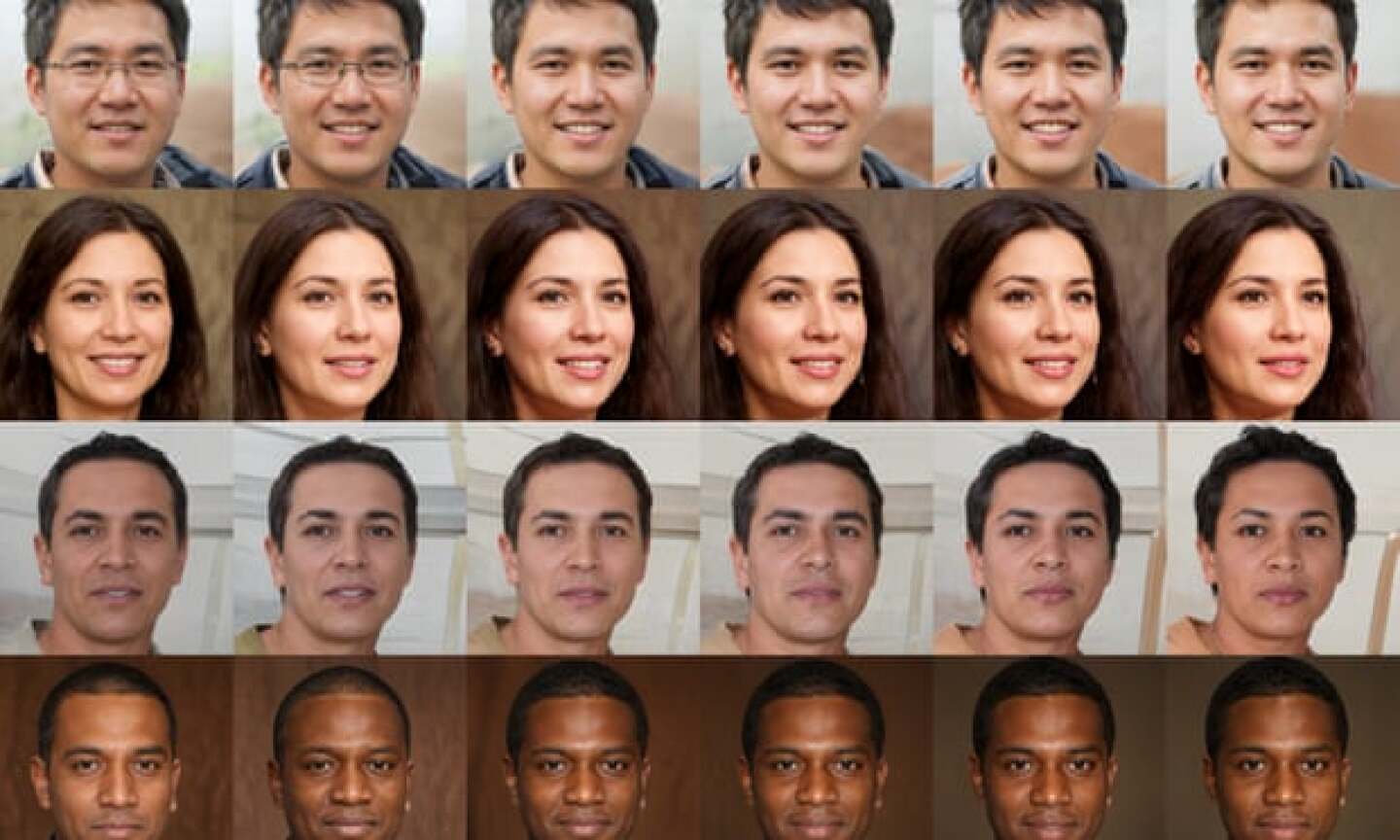

Kulynych comprobó el sesgo generando primero rostros artificiales con rasgos diferentes y pasándolos después por el algoritmo de recorte de Twitter para ver en cuáles se enfocaba el software.

Lee también: ‘Me di cuenta que me había convertido en masoquista y dejé Twitter’

Dado que los rostros eran artificiales, fue posible generar caras casi idénticas pero en diferentes puntos en los espectros del tono de la piel, el ancho, la presentación del género o la edad, para así demostrar que el algoritmo se enfocaba en los rostros más jóvenes, más delgados y más claros, en lugar de los más viejos, más anchos o más oscuros.

“Cuando pensamos en los sesgos de nuestros modelos, no se trata solo de lo académico o lo experimental... sino de cómo eso también funciona con nuestra forma de pensar en la sociedad”, comentó Rumman Chowdhury, jefe del equipo de ética de inteligencia artificial de Twitter en la conferencia de seguridad.

“Utilizo la frase “la vida imitando al arte imitando a la vida”. Creamos estos filtros porque pensamos que eso conforma lo que es ""bello"", y eso termina entrenando a nuestros modelos e impulsando estas nociones irreales de lo que significa ser atractivo”.

Twitter fue objeto de críticas en 2020 por su algoritmo de recorte de imágenes, después de que los usuarios notaron que parecía centrarse regularmente en los rostros de personas blancas sobre los de personas negras, e incluso en los perros blancos sobre los negros. La compañía se disculpó inicialmente, dijo: “Nuestro equipo hizo pruebas de sesgo antes de enviar el modelo y no encontró evidencia de sesgo racial o de género en nuestras pruebas. Pero estos ejemplos dejan en claro que debemos realizar más análisis. Seguiremos compartiendo lo que descubramos, las medidas que tomemos y abriremos nuestro análisis para que otros puedan revisarlo y replicarlo”. Sin embargo, en un estudio posterior, los propios investigadores de Twitter solo encontraron un sesgo muy leve a favor de los rostros blancos, y de los rostros de las mujeres.

Lee también: ¿Qué eran los fleets a los que Twitter dijo adiós?

La disputa provocó que la empresa lanzara la recompensa por errores de algoritmo, en la que prometía miles de dólares en premios para los investigadores que pudieran demostrar resultados perjudiciales del algoritmo de recorte de imágenes de la empresa.

Kulynych, el ganador del premio, afirmó que tenía sentimientos encontrados sobre la competencia. “Los daños de los algoritmos no son solo “

errores”

. Fundamentalmente, mucha de la tecnología dañina no es dañina por accidentes o por errores involuntarios, sino por diseño. Esto proviene de la maximización del compromiso y, en general, del beneficio que externaliza los costos a otros. Por ejemplo, la amplificación de la gentrificación, la reducción de los salarios, la difusión de clickbait y la desinformación no se deben necesariamente a los algoritmos ‘sesgados’”.